ML

Loss Function: Log Likelihood Loss

mingyung

2023. 8. 5. 17:42

Loss Function

quantifies our unhappiness with the scores across the training data.

모델의 학습 결과로 얻어낸 예측값(score)이 실제값과 얼마나 다른지 수치화할 수 있어야 한다.

이것을 가능하게 하는 것이 Loss function이다.

Loss function(=cost func)을 통해 얻어낸 unhapiness를 우리는 loss(cost)라고 부른다.

Loss를 계산하는 몇가지 방법에 대해서 알아보자.

Log Likelihood Loss

이전에 알아보았던 hinge loss는 모델의 score값을 이용하여 loss값을 계산하였다.

이제는 모델이 각 class로 판단할 확률에 기반하여 loss를 계산해보자.

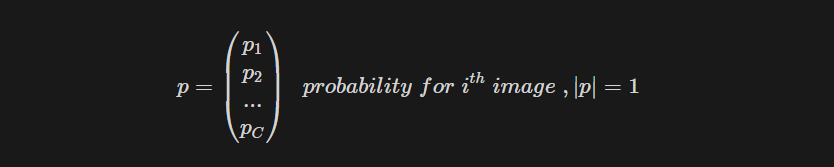

어떤 방식으로 모델이 각 class로의 확률인 p를 알았다고 가정하자. (확률p를 구하는 방식은 다음 포스팅에 소개)

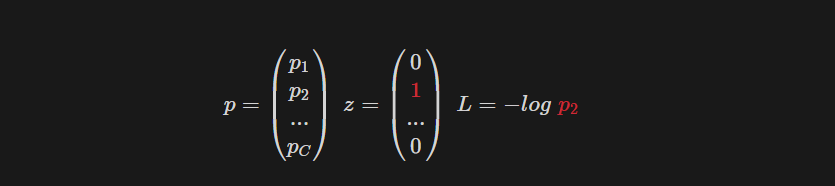

이때, Log likelihood loss 식은 다음과 같다.

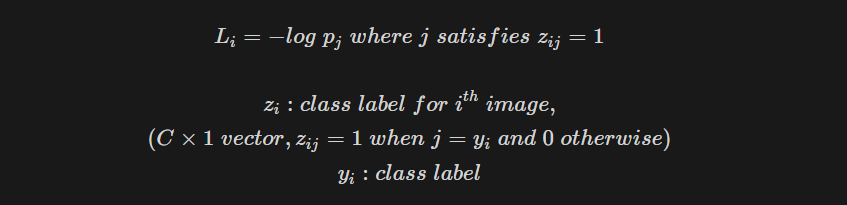

식을 풀어서 설명하면 다음과 같다.

p는 이미지에 대한 estimated probability로, 각 class에 대한 확률이다. 이때 이는 normalized되어 있으므로 |p|=1이다.

z는 이미지에 대한 정답 class만 1이고, 나머지 값은 모두 0인 벡터이다.

Loss는 z인 정답 class의 확률에 -log를 취한 값이다.

예를 들어, 이미지의 정답 class가 2인 경우, z와 Loss는 다음과 같다.

즉, log likelihood loss는 정답 class에 대한 확률에 -log를 취한 값이다.